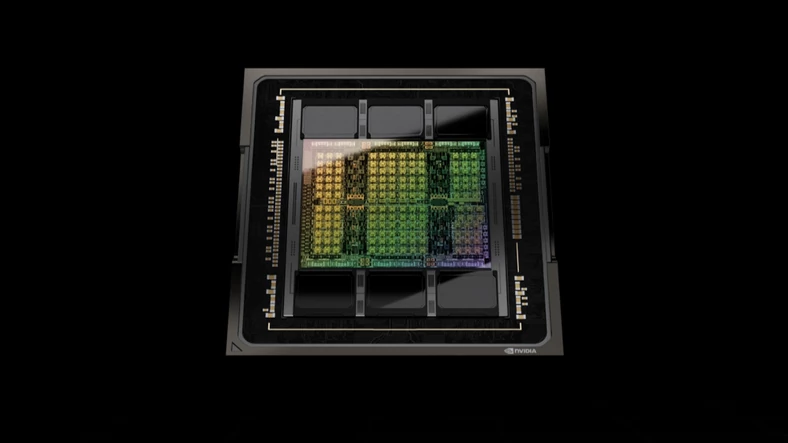

Podczas imprezy GTC 2022 Nvidia zaprezentowała wiele interesujących rozwiązań technologicznych. Największą uwagę zwraca pokazany sprzęt, w tym długo wyczekiwany akcelerator H100, bazujący na architekturze Hopper. To prawdziwa wydajnościowa bestia, która może w pewnym stopniu pokazać, jak mogą wyglądać przyszłe karty graficzne dla graczy.

Prezentacja Nvidii na GTC 2022 obfitowała w masę interesujących zapowiedzi i ogłoszeń. Przedstawiono nowe techniki AI, rozszerzone możliwości Omniverse, technologie dla motoryzacji czy inteligentnych fabryk. Było też sporo no nowościach sprzętowych. Zdecydowanie najistotniejszą zapowiedzią był jednak nowy akcelerator H100. To potężna konstrukcja przeznaczona do platform obliczeniowych, mająca napędzać obliczenia SI.

Zieloni wprowadzili znaczące usprawnienia w nowej architekturze Hopper, dotyczące głównie przepustowości pamięci i ilości operacji wejścia wyjścia dla uczenia maszynowego. Flagowy chip GH100 składa się z 80 mld tranzystorów i jest wykonany w technologii TSMC 4N, będącej ulepszoną odmianą litografii 5 nm. W porównaniu do A100 znacząco zwiększyła się liczba rdzeni, taktowanie zegara i niestety też pobór energii (ten jest na poziomie aż 700 W). Ma to jednak przełożenie na wydajność – w niektórych zadaniach wzrosła ona ponad trzykrotnie. Szczegóły na temat jednostki znajdziecie w załączonej tabeli.

| H100 | A100 (80GB) | V100 | |

|---|---|---|---|

| Rdzenie CUDA | 16896 | 6912 | 5120 |

| Architektura | Hopper | Ampere | Volta |

| Rdzenie Tensor | 528 | 432 | 640 |

| Zegar Boost | ~1.78GHz(Not Finalized) | 1.41GHz | 1.53GHz |

| Zegar pamięci | 4.8Gbps HBM3 | 3.2Gbps HBM2e | 1.75Gbps HBM2 |

| Szyna pamięci | 5120-bit | 5120-bit | 4096-bit |

| Przepustowość pamięci | 3TB/sec | 2TB/sec | 900GB/sec |

| Ilość pamięci | 80GB | 80GB | 16GB/32GB |

| Wydajność FP32 | 60 TFLOPS | 19.5 TFLOPS | 15.7 TFLOPS |

| Wydajność FP64 | 30 TFLOPS | 9.7 TFLOPS(1/2 FP32 rate) | 7.8 TFLOPS(1/2 FP32 rate) |

| Wydajność INT8 | 2000 TOPS | 624 TOPS | N/A |

| Wydajność FP16 | 1000 TFLOPS | 312 TFLOPS | 125 TFLOPS |

| Wydajność TF32 | 500 TFLOPS | 156 TFLOPS | N/A |

| Wydajność FP64 (Tensor) | 60 TFLOPS | 19.5 TFLOPS | N/A |

| Połączenia | NVLink 418 Links (900GB/sec) | NVLink 312 Links (600GB/sec) | NVLink 26 Links (300GB/sec) |

| Chip (wielkość) | GH100 (814 mm2) | GA100 (826mm2) | GV100 (815mm2) |

| Liczba tranzystorów | 80 mld | 54,2 mld | 21,1 mld |

| TDP | 700W | 400W | 300W/350W |

| Proces produkcyjny | TSMC 4N | TSMC 7N | TSMC 12nm FFN |

| Typ interfejsu | SXM5 | SXM4 | SXM2/SXM3 |

Nvidia wskazuje, że w przypadku architektury Hopper zastosowano sporo ciekawych usprawnień, włącznie z poufnym przetwarzaniem danych, ulepszeniem wieloinstancyjnego środowiska, czy zastosowania nowej wersji NVLink. Hopper jest też pierwszym GPU, obsługującym interfejs PCIe 5.0. Tak rozbudowany układ może być łączony z innymi, osadzonymi na tej samej płycie bazowej HGX.

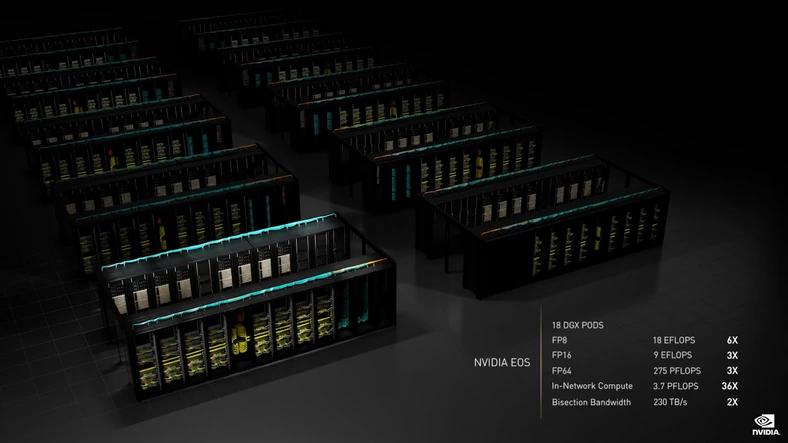

Razem z akceleratorem Nvidia H100 zapowiedziano też systemy DGX H100, mające na pokładzie osiem takich układów i łącznie 640 GB pamięci HBM3. Taki zestaw zapewnia wydajność na poziomie 5 PFLOPS dla obliczeń FP16 i do 10 PFLOPS dla INT8. To jednak nie koniec, bo klienci mogą taki zestaw połączyć z innymi, tworząc w ten sposób platformę DGX POD wyposażoną w nawet 256 akceleratorów. Niezbędne do tego było wykorzystanie nowego przełącznika, oferującego aż 128 linii NVLink.

Announcing the NVIDIA DGX H100 Systems, the world's most advanced enterprise #AI infrastructure built with the new NVIDIA H100 Tensor Core GPUs. #GTC22 https://t.co/nGB36LvZHX pic.twitter.com/rhWfBp563i

— NVIDIA GTC (@NVIDIAGTC) March 22, 2022

Na tym jednak jeszcze nie koniec, bo Nvidia zbuduje też superkomputer EOS, wykorzystujący platformę DGX SuperPOD. Konstrukcja będzie wyposażona w aż 576 systemów DGX H100, czyli będzie oferować aż 4608 akceleratorów H100. Jej wydajność w obliczeniach AI ma wynieść aż 18,4 EFPOPS. System ma zostać uruchomiony pod koniec tego roku.

Poza układami GPU Nvidia przestawiła również swój procesor Grace. To 144-rdzeniowy chip bazujący na architekturze ARM Neoverse, składający się z dwóch współpracujących ze sobą układów połączonych przy pomocy technologii NVLink C2C. Nvidia wykorzystała w jego przypadku interfejs o przepustowości 900 GB/s, zapewniła wsparcie dla pamięci LPDDR5x z korekcją ECC i przyłożyła się do optymalizacji wydajności. Ta bowiem ma być całkiem niezła – w SPECrate®2017_int_base Grace osiąga około 740 pkt.

Announcing NVIDIA Grace CPU Superchip for AI and HPC, designed to solve the world’s largest computing problems. #GTC22 https://t.co/UgM9syZHgW pic.twitter.com/By4ZQzcU0g

— NVIDIA GTC (@NVIDIAGTC) March 22, 2022

Do obliczeń AI i HPC zieloni przygotowali natomiast konstrukcję Grace Hopper Superchip. Łączy ona w sobie jeden układ CPU i jeden GPU, które wymieniają dane przy pomocy 900-gigabajtowego interfejsu. Tutaj również stosowane jest połączenie NVLink C2C, a jednostka jest w pełni kompatybilna z pełnym zestawem oprogramowania Nvidii, włącznie z Nvidia HPC, Nvidia AI oraz Nvidia Omniverse.